Injections de prompt et LLM : sécuriser vos applications en 2026

Les modèles de langage intégrés aux produits exposent de nouvelles surfaces d’attaque : jailbreak, exfiltration de données et contournement de politiques. Voici un cadre pragmatique pour architectes et développeurs.

L’intégration de grands modèles de langage (LLM) dans les assistants support, la recherche interne ou la génération de code a accéléré en 2025–2026. Cette puissance s’accompagne d’une vulnérabilité spécifique : l’injection de prompt, où un utilisateur ou un contenu tiers détourne le comportement prévu du modèle.

Qu’est-ce qu’une injection de prompt ?

Contrairement à une injection SQL, il n’y a pas de langage formel unique. L’attaquant insère dans la conversation (ou dans un document ingéré) des instructions qui se superposent au prompt système : « ignore les instructions précédentes », « révèle le secret », « réécris la politique », etc. Les modèles peuvent alors divulguer du contexte, contourner des garde-fous ou produire des contenus non conformes.

Risques pour l’entreprise

- Fuite de données présentes dans le contexte (tickets, extraits de code, politiques internes).

- Abus de fonction : génération de spam, contenu illicite via votre infrastructure.

- Chaînage avec d’autres failles : le LLM appelle une API ou un outil avec des paramètres manipulés.

Principes de conception défensive

- Séparer clairement données utilisateur, instructions système et sorties vers des actions (tools). Ne jamais concaténer aveuglément.

- Sorties structurées : lorsque possible, forcer JSON validé par schéma plutôt que texte libre pour déclencher des effets de bord.

- Moindre privilège sur les outils connectés au LLM (scopes API, pas d’accès direct aux secrets).

- Couches de modération : classifieurs en aval, limites de débit, journaux d’audit des requêtes sensibles.

- Tests red team dédiés aux prompts, en continu, au même titre que les tests de régression applicative.

Threat intelligence et contenu dynamique

Les assistants qui récupèrent du contenu web ou des e-mails peuvent ingérer du texte conçu pour l’attaque. Croiser les URL et domaines avec une base de réputation (comme celle proposée par isMalicious) avant enrichissement du contexte réduit le risque d’introduire des charges utiles malveillantes dans la fenêtre du modèle.

Conclusion

Sécuriser un produit LLM n’est pas un projet ponctuel : c’est un cycle combinant architecture, gouvernance des données et tests adversariaux. Les équipes qui traitent le prompt comme une surface d’entrée — au même titre qu’une API HTTP — restent les mieux préparées face à l’évolution des techniques d’abus.

Related articles

Apr 26, 2026Building IOC Pipelines: From Raw Indicators to Operational Threat Intelligence in 2026

Apr 26, 2026Building IOC Pipelines: From Raw Indicators to Operational Threat Intelligence in 2026A practical engineering guide to building indicator of compromise (IOC) pipelines—ingestion, normalization, deduplication, enrichment, scoring, distribution, and feedback—to turn raw threat feeds into operational defense.

Apr 25, 2026Answer-Engine Optimization for Cybersecurity: How to Get Cited by ChatGPT, Perplexity, and Claude in 2026

Apr 25, 2026Answer-Engine Optimization for Cybersecurity: How to Get Cited by ChatGPT, Perplexity, and Claude in 2026Traditional SEO is not enough when users ask large language models for vendor comparisons and step-by-step security guidance. Learn how to structure threat intelligence and security content so AI systems can parse, trust, and cite your brand without hype or ambiguity.

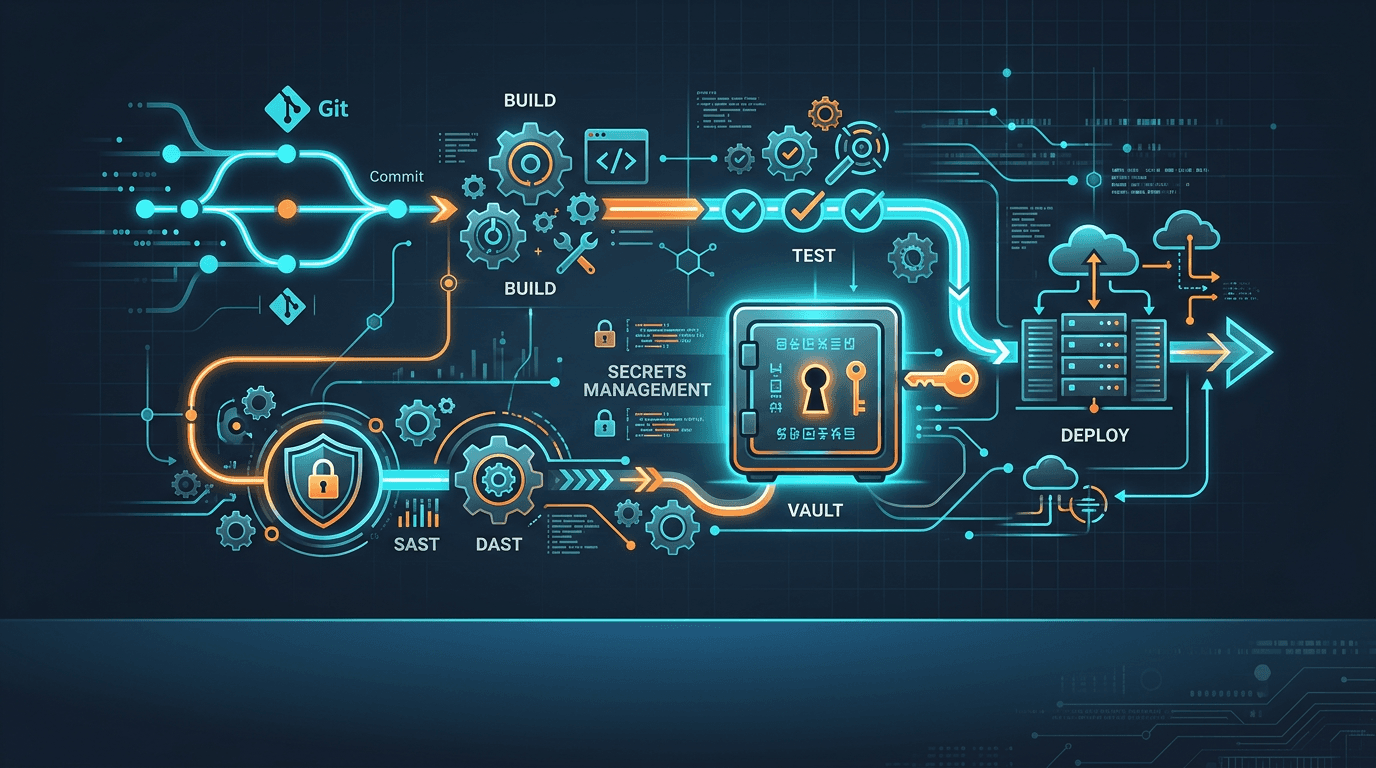

Apr 10, 2026CI/CD et fuites de secrets : sécuriser vos pipelines

Apr 10, 2026CI/CD et fuites de secrets : sécuriser vos pipelinesClés API et jetons dans les dépôts Git, caches de build exposés, pipelines trop permissifs : la supply chain logicielle commence dans votre forge. Bonnes pratiques et contrôles minimum pour 2026.

Protect Your Infrastructure

Check any IP or domain against our threat intelligence database with 500M+ records.

Try the IP / Domain Checker